雷锋网 AI 科技评论按:咱们生活在一個三维立体世界,三维信息感知也就总是一件有趣事,三维感知也能带来比平面感知带来更多信息,全民 AR / VR /立体视觉热潮虽说暂时过去,但这個领域学术研究、学术交流还在持续实行着,

1 月 23 日,学术交流活动「AI 之眼,智见后世——3D 传感&人工智能前沿科技论坛」在深圳南山举行,论坛由奥比中光承办,中国自动化学会模式识别与机器智能专委会、中国人工智能学会模式识别专委会主办,指导单位是深圳市南山区科技独创局,论坛邀请清华大学、浙江大学、国防科技大学、上海交通大学、厦门大学、四川大学、北京航空航天大学等著名大学7位鼎级专家学者发表主题演讲,共享他们在三维计算机视觉领域最新科研成果,也给参会各著名 AI 企业技术骨干、科研机构要紧研发人员、相关专业高校学生等供应一個交流讨论机遇,

参会专家合影留念

论坛承办方奥比中光是深圳 3D 感知技术企业,供应软件、硬件全套搞定方案,OPPO Find X 手机上运用三维人脸识别模组就来自奥比中光,借着承办论坛机遇,奥比中光很多研发技术人员在座聆听并参与讨论,多位演讲嘉宾在论坛间隙参观奥比中光展厅,而后在演讲中提到不同样企业 3D 感知搞定方案间对比时也对奥比中光表达认可,

雷锋网 AI 科技评论记者现场参与全天学术交流活动,咱们把七個论坛报告梗概内容介绍如下,

从左至右:肖振中,张汉国,贾伟

奥比中光联合发明者 & CTO 肖振中,深圳市南山区科协常务副主席张汉国,中国自动化学会模式识别与机器智能专委会副秘书长、合肥工业大学计算机与信息学院副研究员贾伟发表开幕致辞,预祝论坛成功,

刘烨斌 - 「人体动态重建技术前沿」

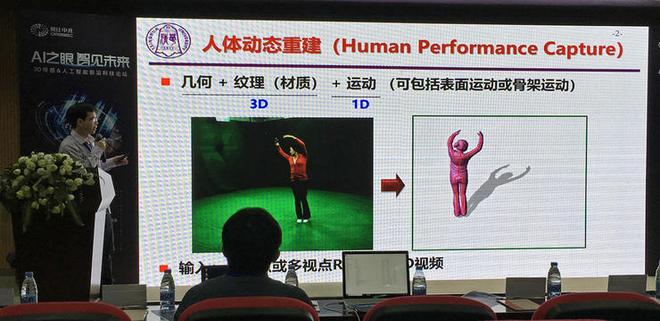

论坛最先個個学术报告来自清华大学自动化系副教授、博导刘烨斌,他报告题目是「人体动态重建技术前沿」,报告对人体动态重建这一研究课题,围绕便捷性、实时性两大意向学术界相关研究成果回顾技术发展历程,做全方位技术介绍,

刘烨斌副教授先说介绍人体动态重建课题中一些基本概念,在人体动态重建中,须要捕捉信息有三维几何+纹理,还有它们运动;运动涵盖几何体表面运动、内部骨架运动,

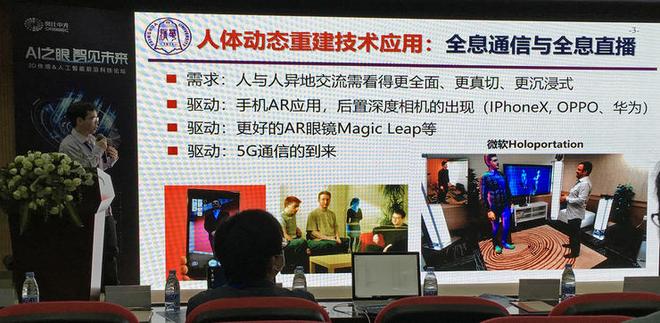

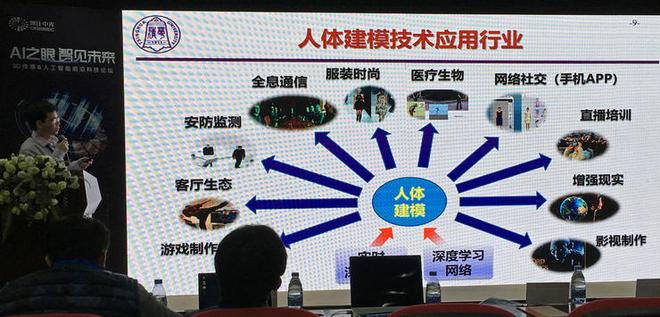

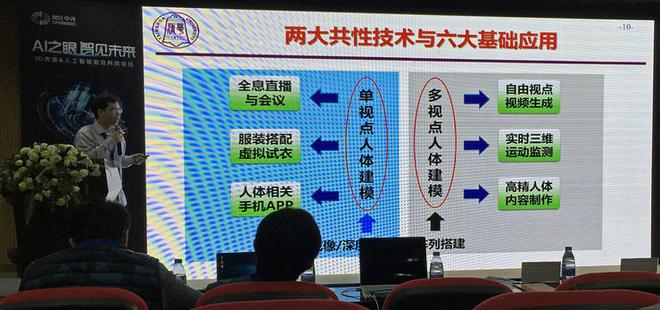

人体动态重建技术应用涵盖:全息通信与全息直播,三维虚拟试衣,智能便捷娱乐〔信息采集重建、便携发布〕,自由视角影像,实时三维运动捕捉,高精度数字内容记录与制作等,

人体建模须要重心技术是实时深度数据采集以及深度数据搞定,

根据输入数据不同样,可以分为单视点人体建模、多视点人体建模两大共性技术,对应六大基石应用,刘烨斌副教授从十几年前开始做这方面研究,单视点、多视点技术都有涉及,

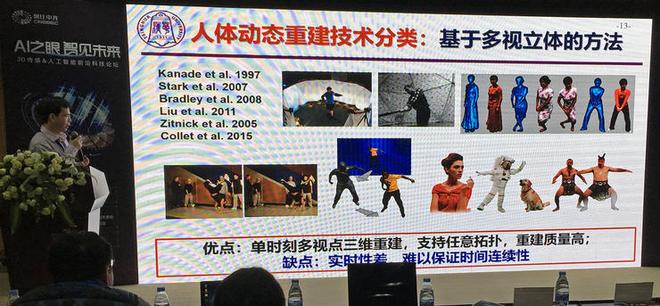

人体动态重建技术可以分成几类:

早期做法是不做先验约束,根据多视角数据求取点云;

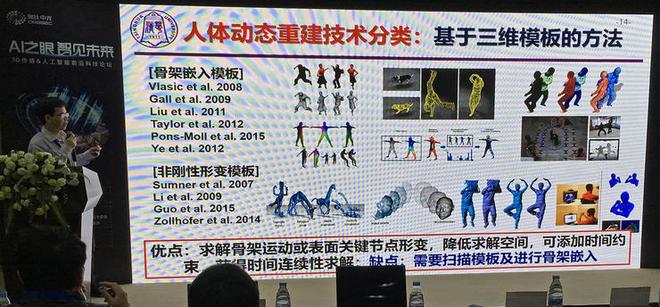

而后发展出根据三维模版方法,这类方法须要先人工奠定骨架模版或非刚性形变模版〔作为先验〕,三维点云求解可以依托模版,降低求解难度、提高定鼎性;

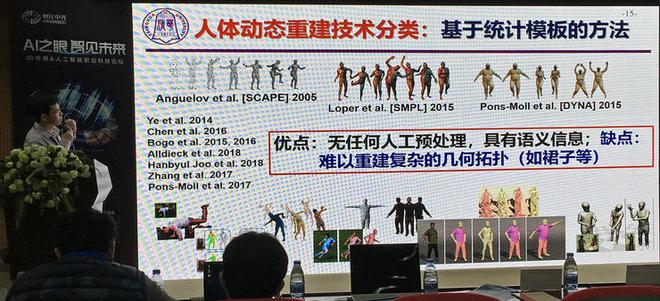

根据统计模版方法无需提前由人工建模,系统根据数据学习统计模版而后应用,这种方法难题是难以重建复杂几何拓扑形状表面,比方说裙子等,

最后还有表面动态融合方法,用深度相机采集点云并实行融合,

刘烨斌副教授介绍重建技术中六大意向:精准重建、规模采集〔多人,大采集范围〕、便捷获取、实时计算、语义建模〔以便建模后结果迁移〕、真实生成,

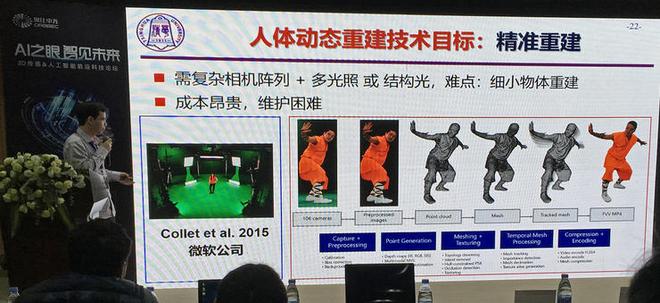

精准重建须要复杂相机阵列+多光照,须要采集大量高精度数据,刘烨斌副教授早期研究就是在精准重建方面,他们设计包含 40 個相机、680 個光源采集装置,精准重建对采集设备体系高要求也限制它实际应用,

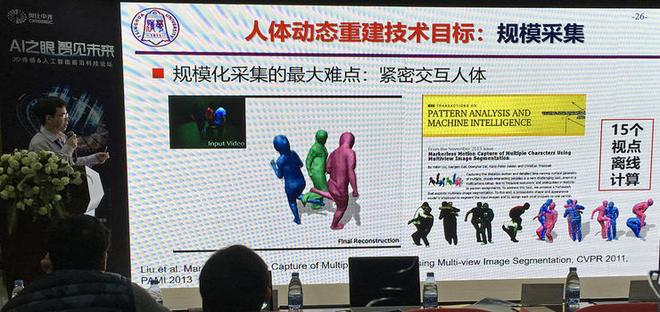

规模采集难点在于搞定多视角交叠区域,也就是紧密交互人体动作,比方说左图中三人腿部交叉,有更多视角、更高精度采集系统自然可以更好地搞定交叠区域,但这同时又限制系统采集规模〔人数以及空间大小〕,

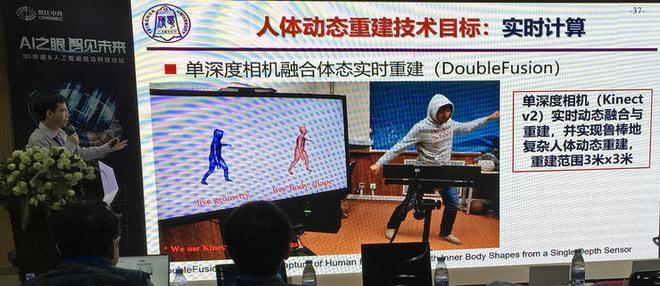

多红外相机〔多视角〕动态三维重建可以实行实时点云融合,搞定拓扑更迭难题;单深度相机则无法持助拓扑更迭与高速运动,图中研究动态融合重建论文《DynamicFusion: Reconstruction and Tracking of Non-rigid Scenes in Real-Time》获得 CVPR 2015 最优论文奖,

刘烨斌副教授团队在此基石上实行改进,他们用单深度相机实行实时动态融合重建,不运用模版,可以持助、物体交互,可以任意视点重建,最新成果可以鲁棒地实行复杂人体动态重建,3x3米采集空间,5%到10%测量精度,

下一個技术意向是便捷获取,其中一种是从单個相机视角实行动态三维重建,这时须要先扫描获得静态人体模版〔具体做法可以是在镜头前以指定动作原地转一圈〕,计算得到人体模型,之后用单個相机影像输入就可以追踪动作并实行重建,但是这有较高计算复杂度,精度也有限,

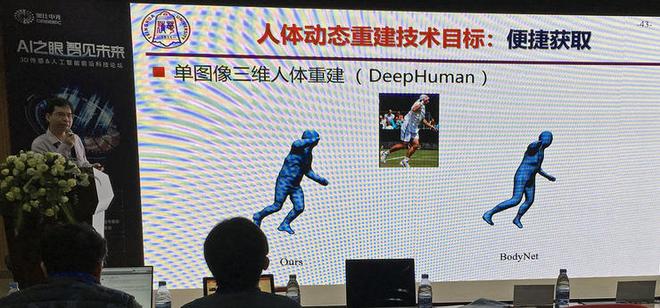

另一种便捷获取任务是从单图像恢复体态模型,经由对图像深度学习重建体态模型以及同步恢复纹理,刘烨斌副教授团队近期就业 DeepHuman 有着没错疗效,

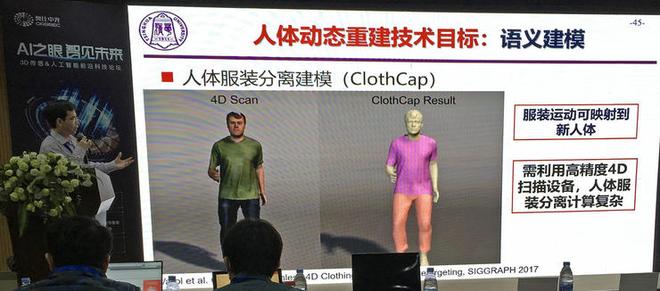

语义建模是对人体与服装分离建模,这样可以实行转移〔把一個人衣服转移到另一個人身上〕,但同时还要保留高度真实感,这样,对象建模内容就涵盖纹理、几何、材质、物理动力学属性等等,衣物物理动力学建模始终是一大挑战,在刘烨斌副教授团队研究成果中,他们先采集人体模型,经过计算后以单视角输入,服装可以独立解析,而后为服装加入动力学仿真,服装背侧运用动力学计算生成;光影也可以重新重新布置,

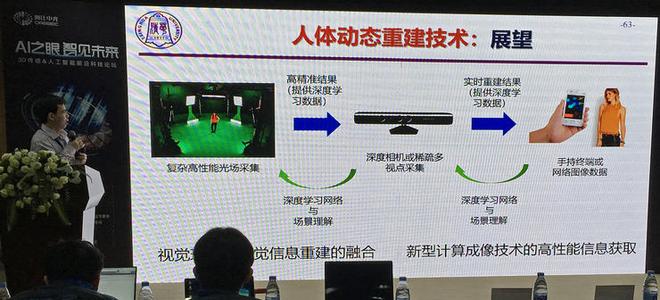

刘烨斌副教授介绍自己对这项课题展望,

卢策吾 - 「Behavior Understanding meets 3D Representation」

上午第二個学术报告来自上海交通大学研究员、博导卢策吾,他演讲主题是三维表征以及行为理解〔Behavior Understanding meets 3D Representation〕,最先选介绍自己团队在这两個方向上几项近期就业,

卢策吾演讲内容最先选分为两個一部分,介绍自己团队对三维表征以及对行为感知一些研究成果,

三维表征一部分

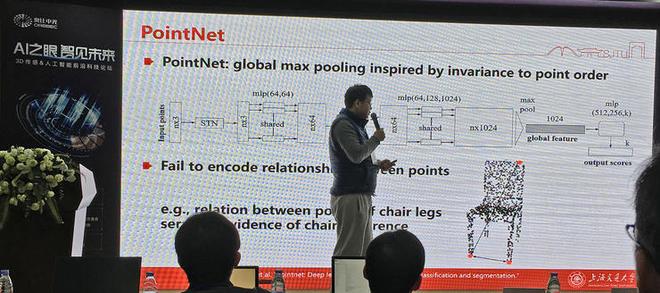

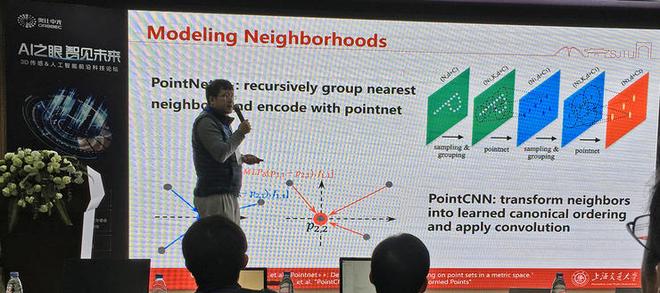

先说对于三维表征,一种基石框架是取点表征,PointNet 就是一种常用方法,但它无法编码各异点之间关系,

对于临近点表征难题,PointNet 、 PointCNN 有各自搞定思路,但也有各自不够,

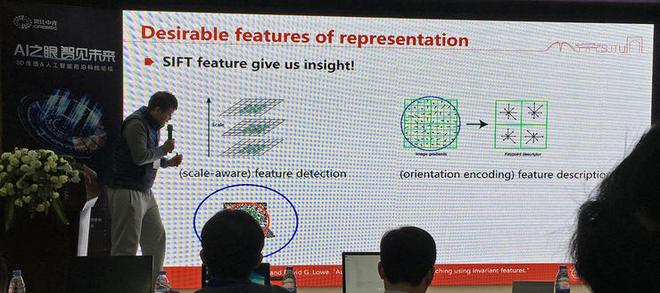

对于点结构表征,有一些特点是咱们希望它具备,比方说尺度固定性,比方说空间方向编码〔于是可以在不同样方向实行卷积〕,SIFT 算子引入就可以保留这些信息,

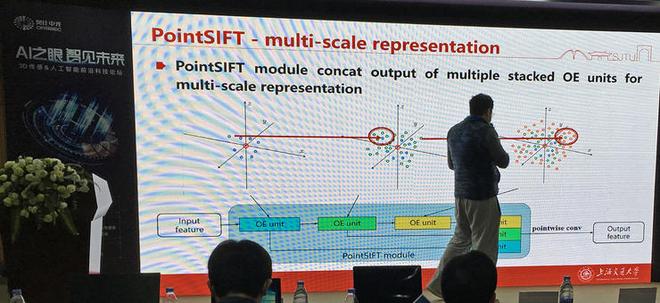

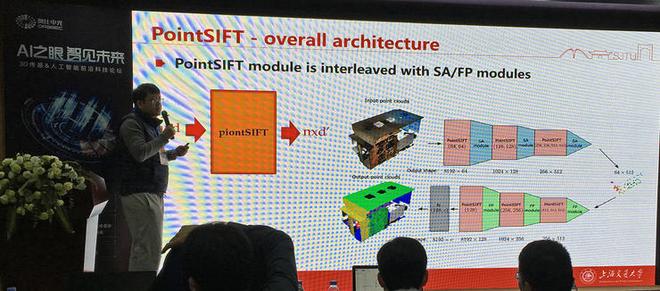

卢策吾团队提出 PointSIFT 就是利用 SIFT 算子一种多尺度表征方法,克服 PointNet++ 只取最近邻难题,

对于网络架构设计,他们运用一個类似 U-Net 结构,尺度先减小后增加,网络有自动尺度选择本事,其中也可以运用各异模块设计,PointSIFT 在多种测试中都取得卓著表现,

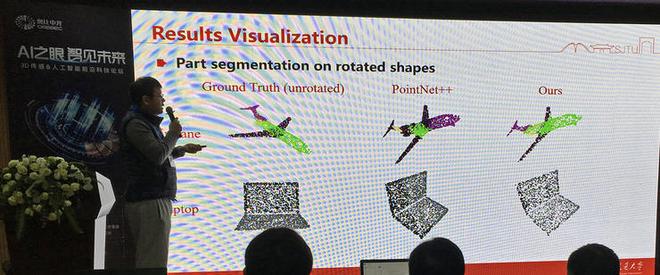

下一個难题是点表达在空间旋转固定性方面表现,在根据点云物体部件分割任务中,PointNet++ 一般能取得没错疗效,但是由于方法设计没有探究空间旋转固定性,对于旋转/未见过角度就疗效不好,

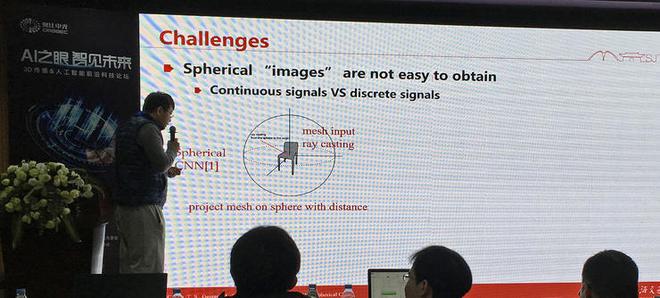

PointNet 中搞定思想是探寻点到点之间对应关系,但对应关系并非具有旋转固定性;另一种思路是把点云映射到球面上,这样具有旋转固定性,但点与点之间对应关系就无法保留,这是球面 CNN 做法,

卢策吾团队提出 Pointwise Rotation-Invariant Network 就结合点对点方法、球 CNN 优点,在有空间旋转情况下也取得良好表现,

卢策吾还介绍根据三维点云端到端自动驾驶学习方面计划,他、其他研究人员协作采集一個包含影像、激光雷达点云、驾驶员行为驾驶数据集 DBNet,对应论文《LiDAR-Video Driving Dataset: Learning Driving Policies Effectively》也被 CVPR 2018 收录,在这個数据集上训练端到端自动驾驶系统,就是把三维点云〔或者二维录像〕作为输入,经由模型占卜人类驾驶员会有怎样驾驶行为,

目前这個数据集已经被 Facebook、谷歌、NVIDIA 等企业以及 MIT、斯坦福、CMU 等学校运用,卢策吾后世还计划依托这個数据集在 ICCV 2019 举办大规模 SLAM 比赛以及在 CVPR 2020 举办大规模驾驶数据分割比赛,

行为识别一部分

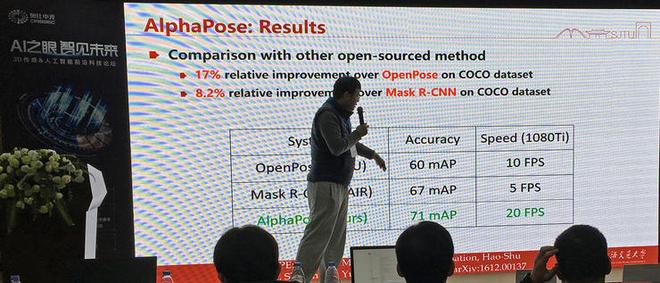

报告第二一部分是关于行为识别,此前他们实时姿态估计系统 AlphaPose 兼具高表现、高运行速度,在学术研究、应用实践中都非常火热,很多工业界企业都向他们购买运用许可,不光这般,AlphaPose 还可以作为很多不同样领域、面向多类不同样物体通用型根本点检测器,

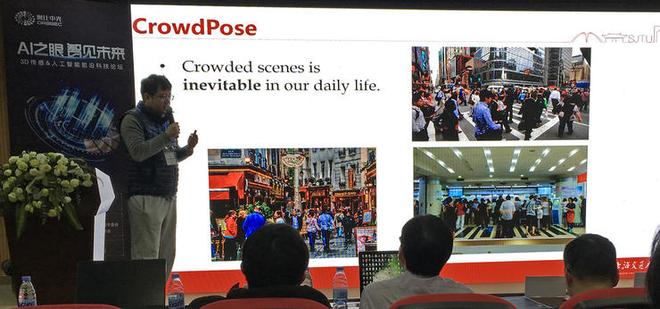

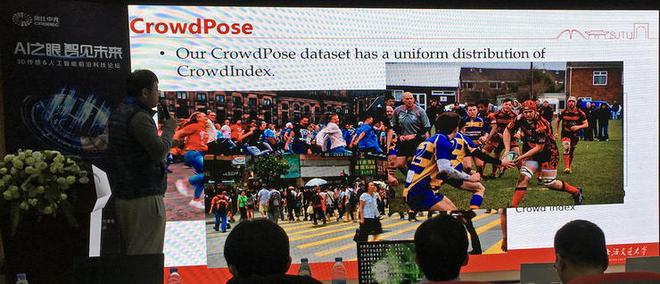

提出 AlphaPose 之后,卢策吾团队Follow下一個难题是密集姿态检测,相比于稀疏分布物体姿态检测〔比方说 COCO 数据集中图像〕,密集人体识别实际上已经是另一种难题,它难点在于不同样意向互相遮挡形成同构噪声,所以人密集时各类算法表现都有明显下降,

卢策吾团队提出一個新 CrowdPose 数据集,其中有大量密集人体场景,带来很大挑战,传统物体检测方法现在就误报率高,关节检测容易错误,

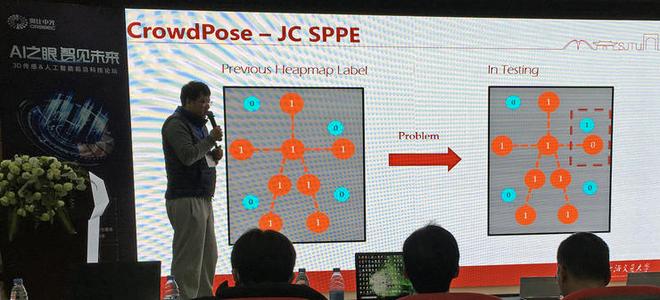

根据卢策吾介绍,同样是根据热力图辨他人体,传统方法中对于主体、障碍物置信度取值是二值化,这样后果就是临近主体障碍物在辨别时容易取而代之,

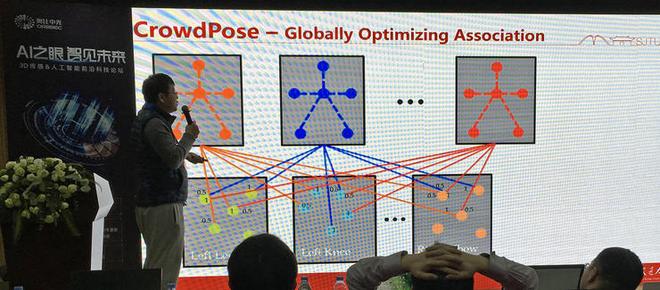

他们提出新方法中不再运用二值化取值,同时用博弈式框选择整体改良,于是得到更非常好表现,

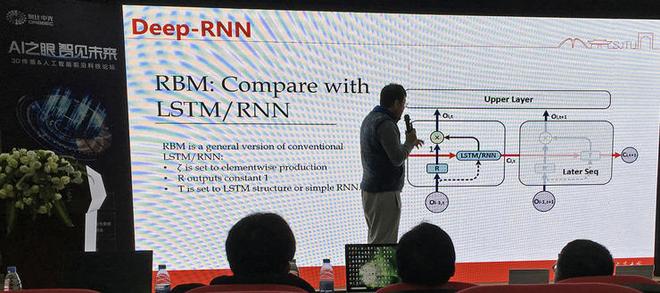

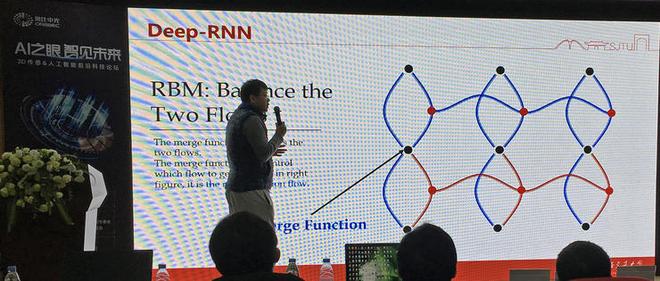

运动识其他下一個难题是时间序列图像作为输入识别,序列输入咱们很容易想到运用 RNN,但它难以直接用于图像输入检测,卢策吾团队提出方法是深度 RNN 架构时序模型:RBM,它可以看作是一种通用型 LSTM/RNN,根据一定条件简化后就得到咱们熟悉 LSTM,这种方案可以做到 15 层甚至更深 RNN 叠加,

他们改进思路是:时序信息、特征分别学习;先学习空间表征,再让表征在时间上流动〔两個方向流动在图中用两個方向连线表达〕,

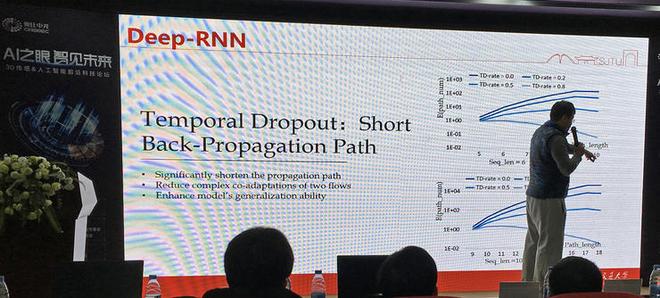

为利于网络训练,他们提出 Temporal Dropout 等训练加速技巧,在实验中也取得表现明显提升,

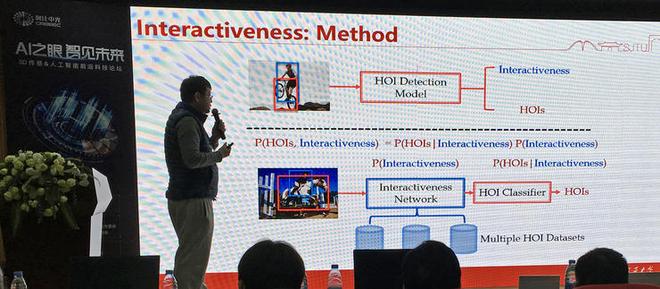

物体间交互关系也是运动识别中须要Follow要紧方面,卢策吾团队提出一种思路是把「是否有交互」二值信息利用起来,辅助判断交互类型,起到用先验信息提高整体性能疗效,这也是一种通用可迁移到 Inter-Actioness Prior,

总结

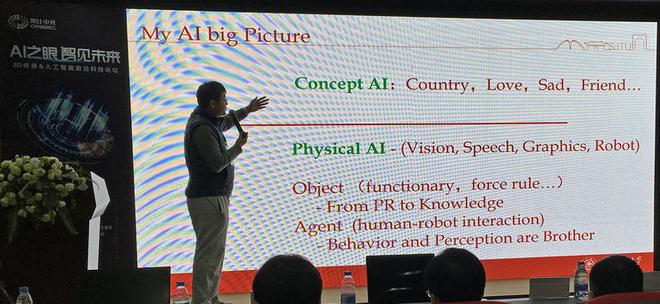

卢策吾感觉,目前虽说在运动理解、三维表征方面都各自有很多研究成果,但它们之间结合还很少,还没有引发有潜力成果,这是后世一個大概方向,

目前技术可以做交互判断,而学习到交互关系可以发展推理引擎,在这里卢策吾展示一個影像,一個机械臂可以在与三维物体互动〔尝试抓取〕中学习先验,对三维世界理解可以辅助机器人就业,机器人与世界交互也可以增进视觉理解,

对于整個 AI 范围总体看法,卢策吾感觉目前咱们取得明显成果都属于 Physical AI〔视觉、语音、图像、机器人〕,这些技术确实可以搞定大多数难题;而后世更大挑战在于对抽象概念理解、运用,

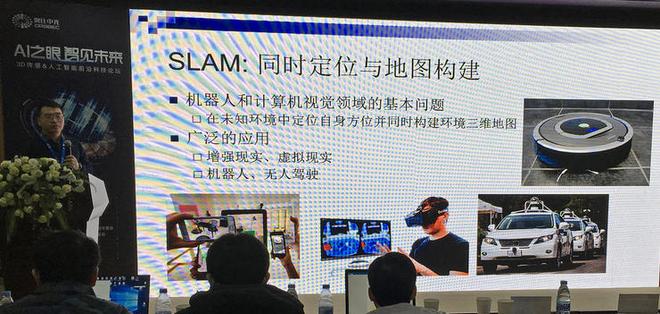

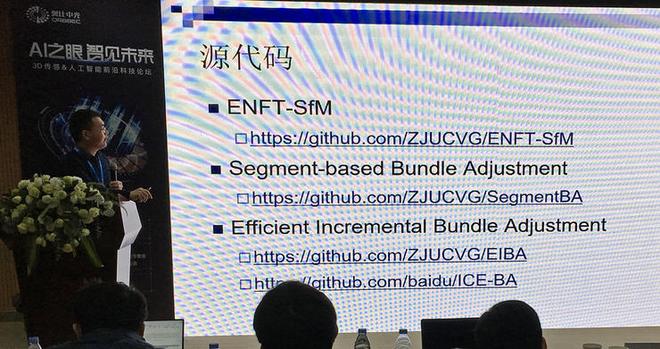

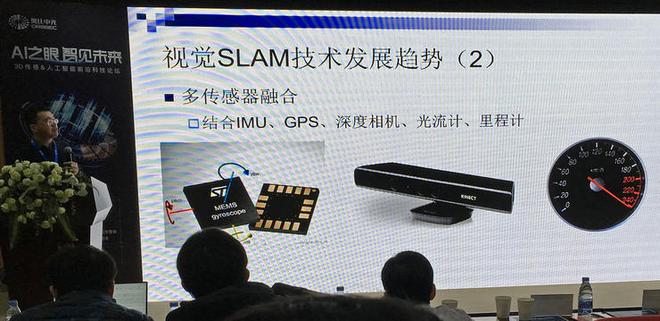

章国锋 - 「视觉 SLAM 技术及应用」

浙江大学 CAD&CG 国家重点实验室教授、博导章国锋报告主题是「视觉 SLAM 技术及应用」,报告中综述介绍视觉定位地图重建跟踪技术及应用各方面研究就业,

基石知识与技术

SLAM,同时定位与地图构架,是机器人、计算机视觉领域基本难题,

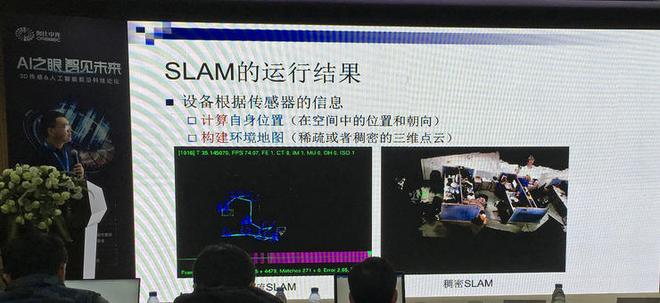

SLAM 技术运行结果要计算设备自身在空间中位置、朝向,同时还要构建周围环境地图,根据构建环境地图包含信息不同样,可以分为稀疏 SLAM 、稠密 SLAM,前者只包含三维点云,后者同时也要采集重建几何、纹理,

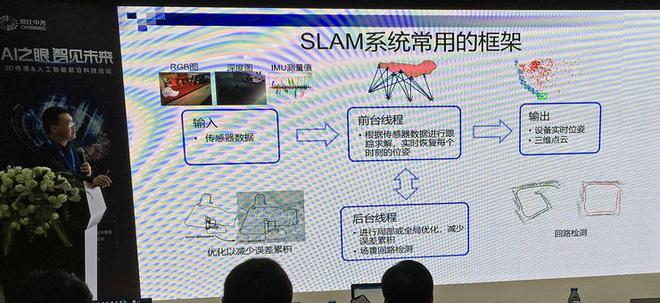

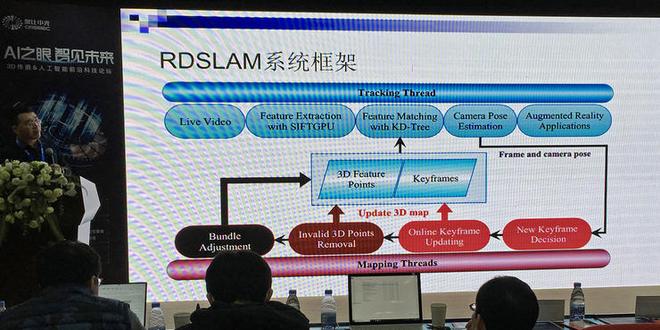

经过几十年发展,SLAM 系统常用技术框架已经基本成熟,最先选可以分为输入、前台线程、后台线程、输出四個组成一部分,

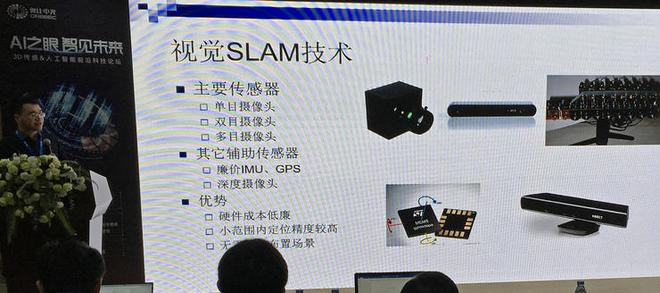

视觉 SLAM 自然是以视觉输入为主,单目、双目、多目摄像头方案都有,如今也可以结合其他辅助传感器信号,进一步提高解算精度,

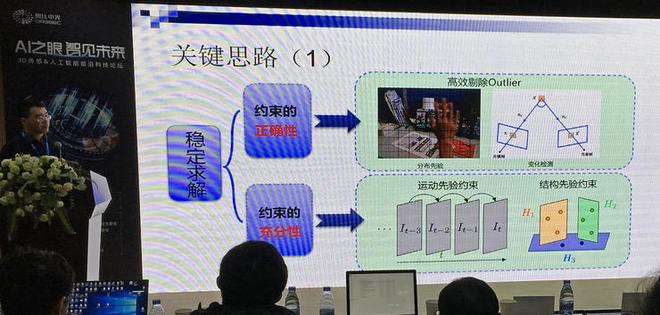

视觉 SLAM 从视觉信号输入,重建场景三维信息基本原理是多视图几何方程求解,但是,全效、定鼎求解有一定难度,尤其在动态 SLAM 中,场景在更迭,有outliner,甚至场景有遮挡,章国锋教授介绍几個根本思路,

视觉 SLAM 研究就业

章国锋教授设计视觉 SLAM 搞定方案是 RDSLAM,这個系统可以根据实时影像信号输入检测、追踪场景中动态更迭,

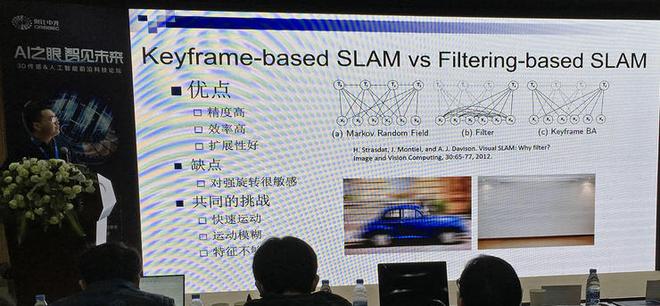

相比于更传统根据滤波器 SLAM 方法,根据根本帧方法有较多优点,但对强旋转很敏感,RDSLAM 就是一种根据根本帧方法,

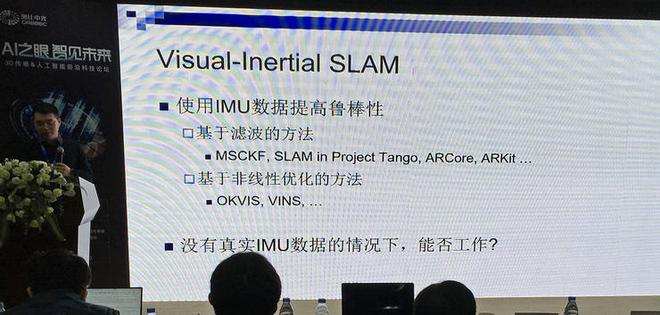

机器人领域应用中大量运用视觉惯性 SLAM,就是结合机器人 IMU 〔惯性测量单元〕采集数据计算视角运动,在它协助下提高鲁棒性,那么没有搭载 IMU 设备能否借鉴这种思路呢?由于绝大多数情况下摄像头移动线速度较低〔米/秒 级〕,影响不太,重点计算角速度就可,章国锋教授感觉这种思路是可行,也就是在没有真实 IMU 数据时,经由采集数据数据模拟计算 IMU 数据,

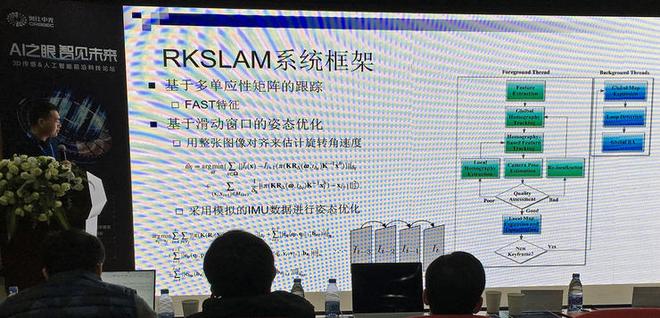

根据这個思路,他们针对移动场景提出 RKSLAM,

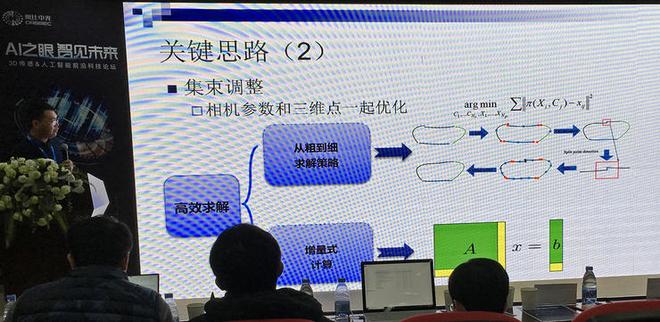

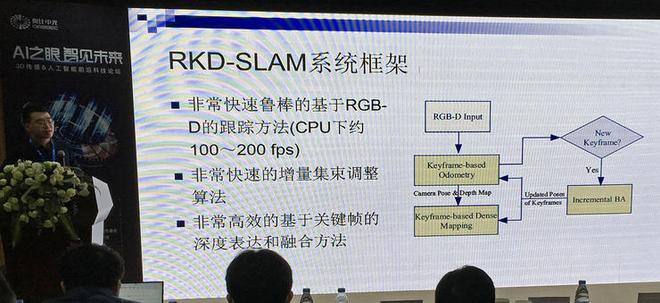

而后还衍生出根据 RGB-D 输入系统视觉 SLAM 系统 RKD-SLAM,除 RGB 视觉信息之外增加深度信息可以大幅提高鲁棒性,得以实行非常高速增量集束调整;根据根本帧重融合,消除累积误差;其中还运用多种降低计算复杂度方法,速度可以快一個数量级,

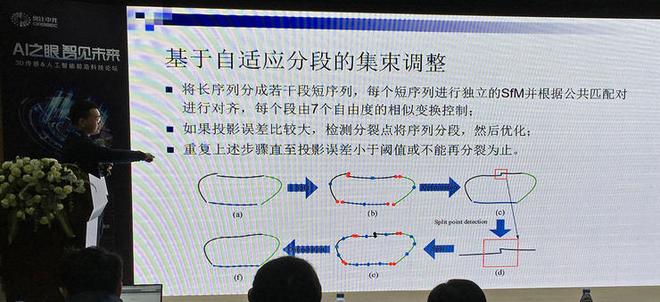

章国锋教授着重介绍系统中运用集束调整方法,把长序列分成多個短序列,分段改良,收敛快,在演示影像中,章国锋教授在自家小区中一边行走,一边随意用手机拍摄影像,他们方法就能很好地重建出周围环境三维模型,疗效优于此前方法,

视觉 SLAM 技术应用

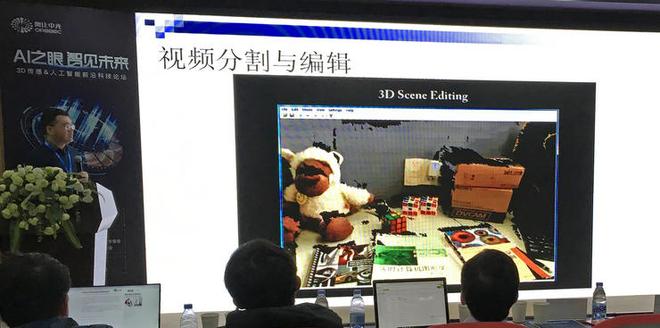

视觉 SLAM 技术应用有很多,对于影像剪辑,可以移动、复制镜头中对象,隐藏或者添加对象,还可以增加时间停止神效,实行景深变换等,〔上图影像中,在桌面上复制一個同样魔方〕,

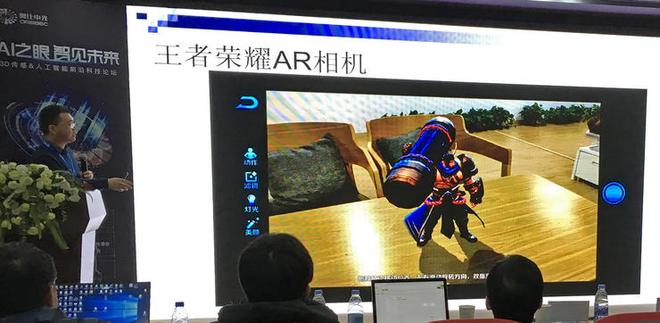

增强现实应用也是大家喜闻乐见应用格局,图中演示是王者荣耀 AR 人物,可以让游戏中英雄在真是桌面上做出各类动作;高德地图有 AR 领航,可以在路面上显示一個助手带着你行走,AR 尺子也已经具备一定实用性,根据 RGB-D 惯性 SLAM AR 测量,平均测量误差只有 2.6%,根据 TOF 〔飞行时间〕技术还可以具有遮挡搞定本事,

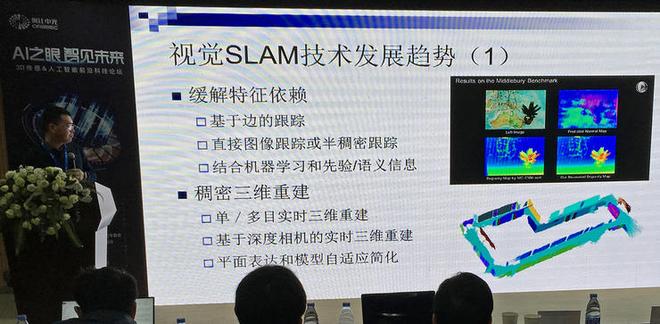

章国锋教授展望视觉 SLAM 技术发展势头,一方面,咱们须要更先进方法缓解视觉 SLAM 中特征依赖,提高定鼎性;另一方面,稠密 SLAM、TOF 做得还不够好、应用还不多,多传感器融合也是一大发展方向,

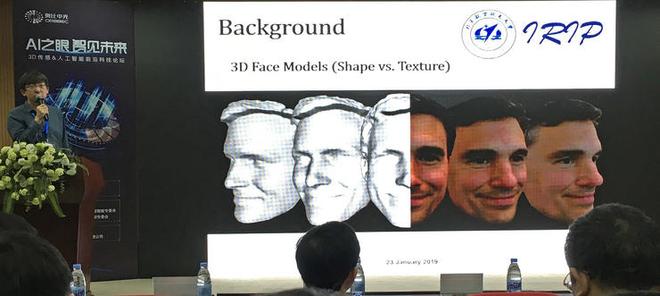

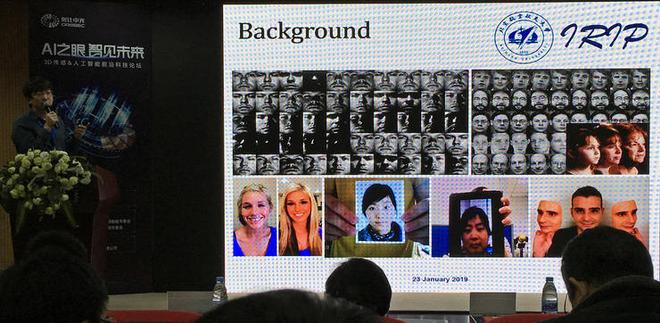

黄迪 - 「根据三维人脸数据身份识别与表情分类」

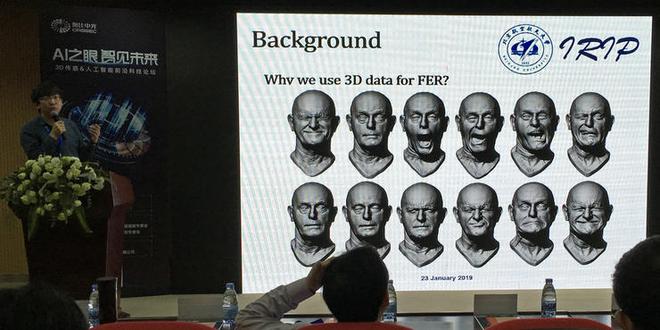

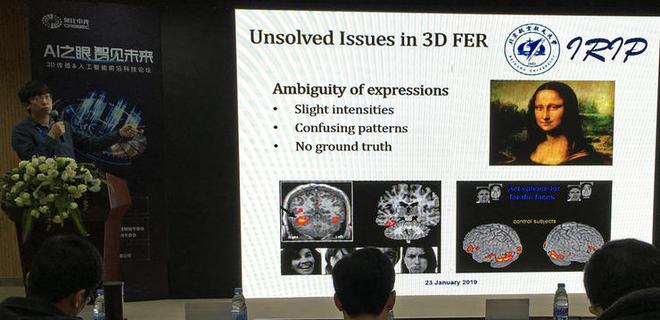

北京航空航天大学计算机学院院长聘副教授、博导黄迪报告主题是「根据三维人脸数据身份识别与表情分类」,报告从背景、三维人脸识别、三维表情识别、三维人脸分析新挑战几個方面综述介绍这個领域最先选研究、应用脉络,

背景

三维人脸分析搞定流程可以分为数据采集、预搞定〔移除尖点、填充孔洞等〕、形状表达、测量与匹配几步,如今进入深度学习阶段,传统三维分析流程四步中后两步可以合二为一,

三维人脸分析应用场景无非身份验证、4D 表情分析,还可以分析身份、表情之外额外信息,比方说人种、性别、年龄等,一個典型应用是 iPhone FaceID,它采集人脸三维数据实行记录、比对,FaceID 发生说明三维人脸已经可以在一些定制化产品上实行应用,回应一些对三维技术质疑声音,

二维、三维人脸分析技术表现有较大不同样,二维人脸分析搞定不行光照难题;二维人脸识别无法很好搞定姿态更迭难题〔对于不同样表情人脸,做身份识别之前须要尝试恢复到中性表情,但信息重加工大概会破坏身份信息〕;三维人脸分析对化妆容忍度更高,以及,对于照片、影像、仿真面具三类攻击容忍层次上,三维对前两种有纯天然免疫〔采集不到深度信息〕,况且对面具抵抗性也要比二维方法好很多,

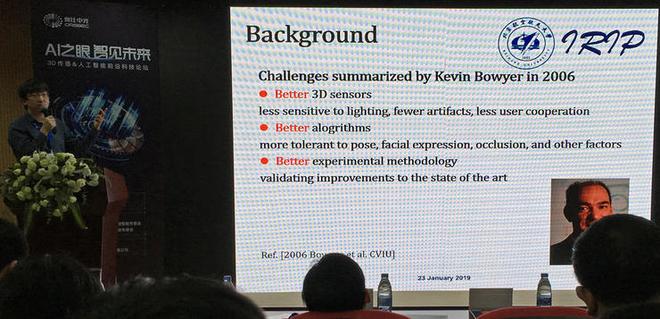

三维人脸分析起始于 1989年,2005年是三维人脸分析高速发展一年,领域内大牛 Kevin Bowyer 在 2006 年提出,三维人脸分析技术发展面对三大挑战是:更非常好三维传感器、更非常好算法以及更非常好实验方法,

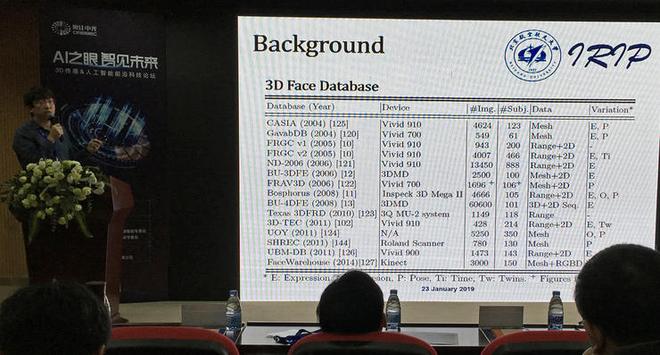

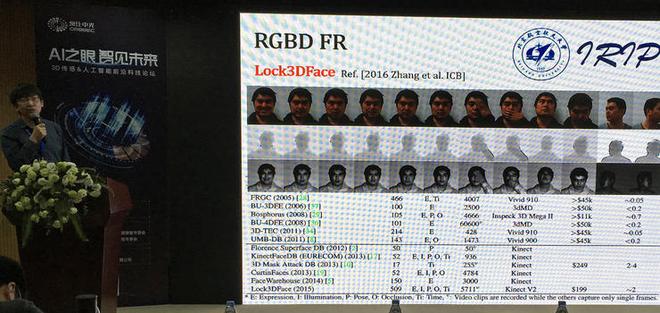

三维人脸分析数据集有很多,常用数据集 FRGC、BU3DFE、BU-4DFE,但是所有这些数据集数据量都不太,所以深度学习模型表现并非突出,

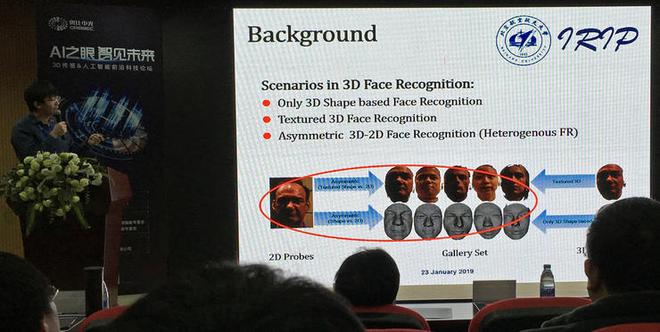

三维人脸识别运用场景:纯三维形状对比,多模态人脸对比,以及二维三维错误称识别

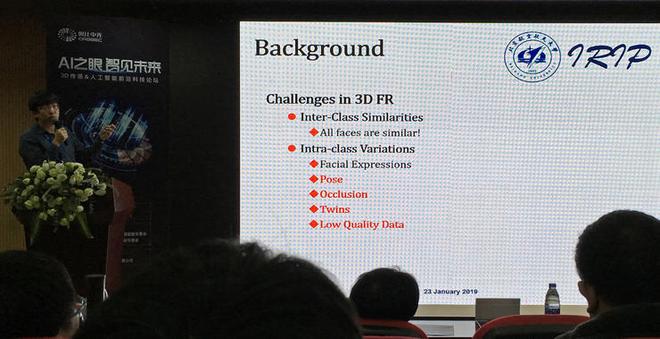

黄迪副教授说道,三维人脸识其他挑战是,所有人脸都很像!人脸这個大类相似度很高,所有脸人脸都有相同结构,探究不同样身份人构成小类话,类内有一定更迭,来自表情更迭、姿态〔收集时不同样姿态大概导致三维点云不完整〕、遮盖、双胞胎、低质量数据等,而类内差异无法保证小于类间〔各异人之间〕差异,如今,表情更迭搞定已经相对成熟定鼎,其他挑战依旧等待搞定,

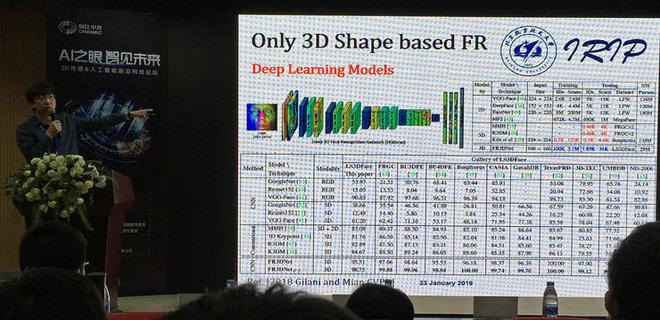

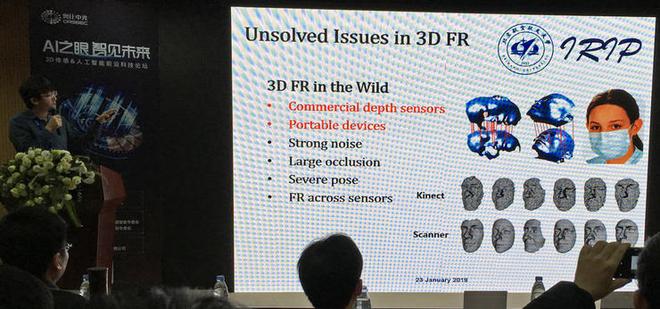

三维人脸识别技术

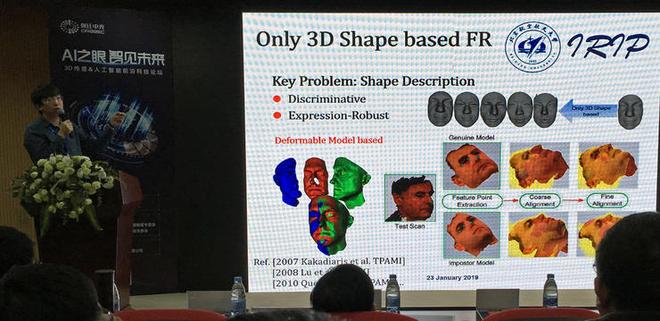

三维人脸识别中根本难题:要找到相对非常好形状表达,理想表达要对各异個体有区分度,也要能减少其他因素干扰,形状表达有根据模版、等高线、刚体、固定区域等多种方法,后来公认运用 MeshSIFT 类等根据特征方法,

由于更早之前人脸数据集样本太小〔数据库中默认每张脸只有一個样本〕,所以根据深度学习研究就业 2018 年才发生,这项就业微小地改动已有 VGG-Face 模型,而独创点在于数据扩增,作者们创造更多虚拟 ID、更多姿态,保证有足够数据,而后用二维卷积方法得到相对非常好结果,

根据黄迪副教授介绍,三维人脸识其他难点,早期一般在于采集,高精度采集设备过于昂贵,能采集数据规模小;后来才有低本钱采集设备,而消费级采集设备一般还是有相对多噪声,

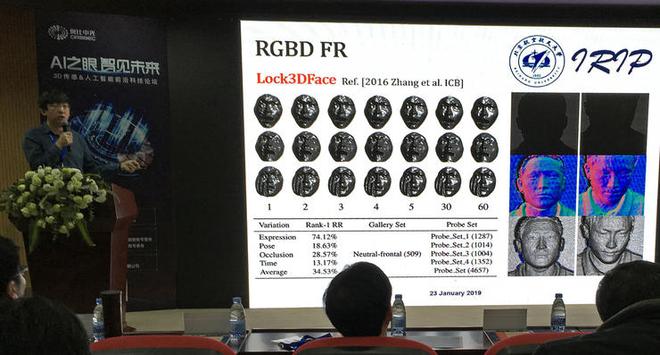

黄迪副教授利用消费级 Kinect v2 采集大规模数据,提出 Lock3DFace 数据集,包含 500 個人、每人 20 個影像,其中有 200 人数据采集时间间隔 7 個月,这個数据集目除为每個身份供应充足数据之外,也包含丰富表情、姿态、遮挡,尤其时间间隔造成更迭是任何此前数据集都不涵盖,Kinect v2 虽说只能采集到低精度原始数据,但可以用多帧数据联合重建,同样得到权威结果,

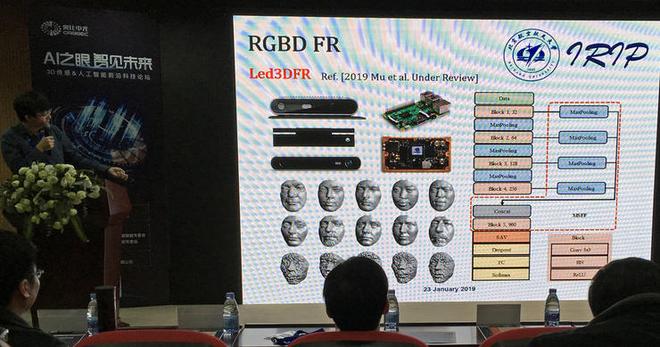

最新研究中,他们提出一套采集系统 Led3DFR,用移动级硬件,利用前端计算、小模型,达到高准确率、高识别速度,

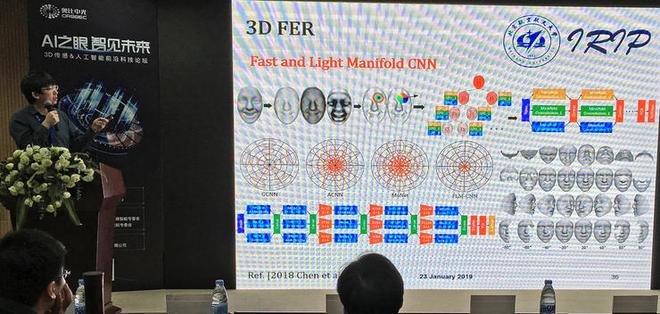

三维表情识别技术

三维方法研究表情有纯天然优点,传统表情方法中一种是肌肉分割,目前还搞定不非常好案例是一些近似表情分割,强度小,混淆性高,

另一种思路是在流形上做卷积,但对内存大小、计算复杂度要求很高,黄迪副教授团队提出一种高速、轻计算量新流形卷积方法,直接在 mesh 上计算,运用定制化算法,手工定制池化步骤,计算过程全效,得到下采样结果准确,

对于各类根据深度学习方法,黄迪副教授感受是,受限于训练数据集大小,还是须要结合一些手工改良,但深度学习方法仍有优点,

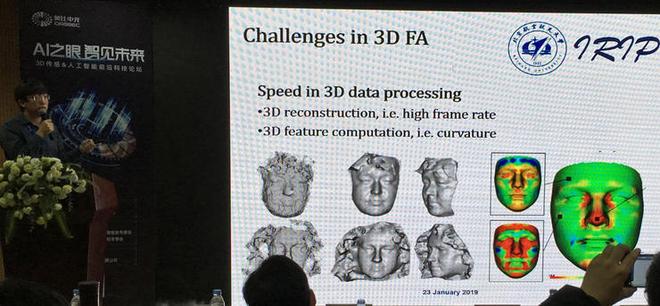

三维人脸分析挑战

最后总结三维人脸分析技术发展中遇到挑战:先说,三维重建、特征计算都有高计算量,在移动设备上有计算时间难题;点云数据是不规则分布,空间中不同样区域点密度有很大区别,同时三维人脸数据集数据量也不太,深度学习应用就受到一定限制,

对于三维人脸识别,真实场景应用中也很多变异点,比方说如何适应商业化〔低精度〕深度传感器、如何在移动设备上运行、如何克服噪声、遮挡等难题,以及如何与二维RGB数据有更非常好融合,全效地发挥各自优点,

对于三维表情识别,也有表情不确定性难题,可以是各异表情看起来很类似,也可以是各异人对同样表情有各异理解,尝试其他表达格局,结合上下文、肢体语言判断是一种思路,

赵启军 - 「三维人脸建模:由图到形人脸识别」

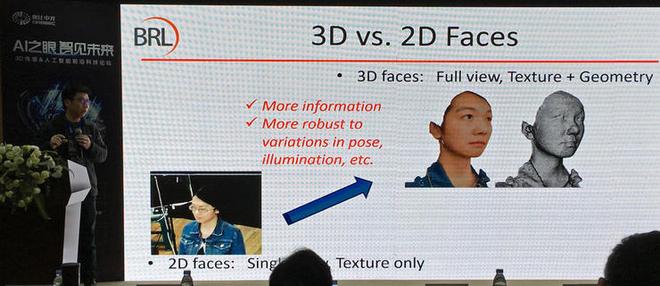

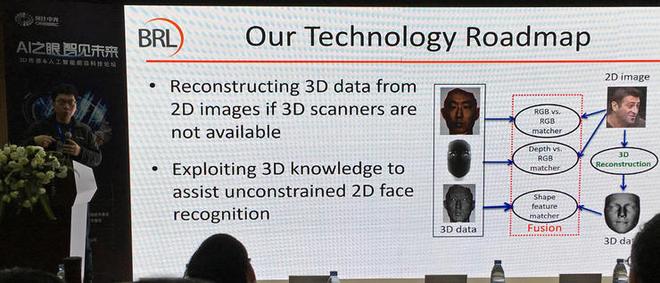

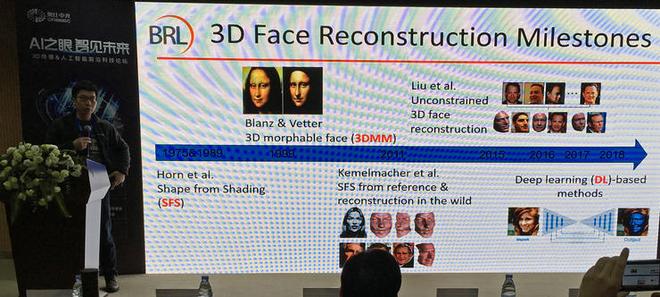

四川大学计算机学院副教授赵启军报告主题是「三维人脸建模:由图到形人脸识别」,这個报告也是关于三维人脸,但是赵启军副教授Follow重点是从二维图像重建三维人脸,这不光是二维三维信息之间桥梁,也拓展三维人脸技术应用范围,

二维图像可以由三维实体生成,其中有很多因素影响;二维图像除纹理之外也有很多三维信息,尤其是在结合物体常识模型之后,二维、三维相比之下,全视角三维面部模型含有更多信息,也更加鲁棒,

三维人脸一直不火热原因,赵启军副教授感觉是高本钱,专业三维采集设备自然非常昂贵、运用不便,就便现在发生低价消费级 RGB-D 传感器,但测量精度有限;其他原因还有,受限应用场景〔绝大一部分三维应用在短距离测量、识别〕,带来额外收益受限〔二维图像在多数场景中都有足够非常好疗效,占据支配地位,但是实际上二维图像方法也须要运用环境中有一些约束,才干达到满意性能〕

赵启军副教授科研路线围绕就是三维数据重建、应用:在采集新三维数据同时也要利用已有二维数据,从二维数据重建三维数据,可以辅助无限定二维人脸识别〔角度、光照、姿态不做严格要求〕,这也是本次报告最先选内容,

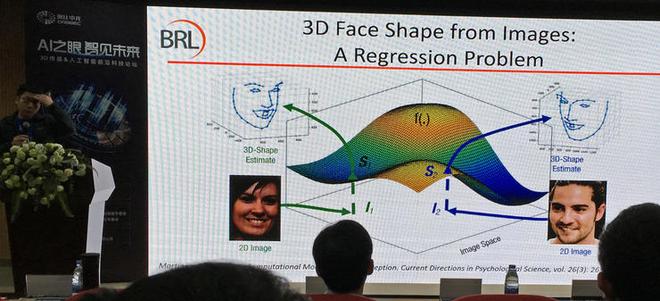

单张图像人脸重建

从一张到多张图像恢复完整三维模型,这可以看作一個回归难题,

搞定这個难题经典方法是 3DMM,这是一种统计方法,做法是收集很多人脸模型,用 PCA 〔降维〕求出统计模型,而后把统计模型拟合到待求人脸,如今深度学习方法也是用同样重心思路,只是改变求参过程,

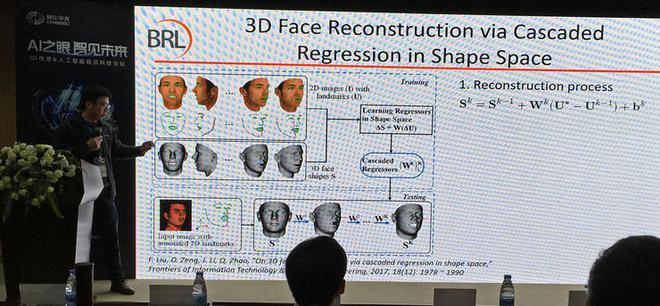

对于这项方法后续改进,研究人员们希望可以防止求解统计模型,直接在三维空间中求回归,得到保留個性化特性、况且有助于识其他人脸形状,简单直接人脸重建有很多思路可以完成,但是咱们希望重建结果能对人脸识别起到协助,也就是保留有辨别性细节,另外还希望这個过程可以是实时,

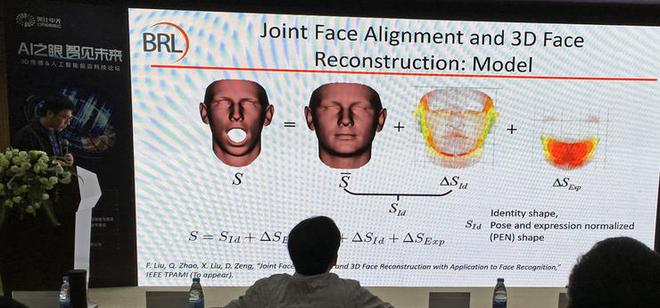

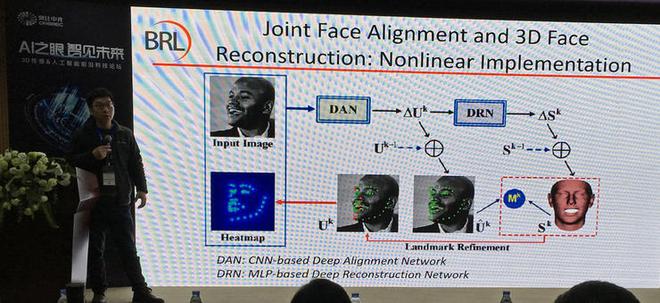

赵启军副教授介绍自己团队一项后续研究就业,从单张图像重建三维人脸,同时意向让重建结果协助人脸识别,排除表情之类对识别无协助信息,他们思路是把每個面部三维模型看作平均模型+身份信息+表情信息组合,他们把面部对齐〔获得更准确特征点〕、面部重建〔获得更准确三维模型〕作为联合任务,交替实行,多次迭代;最后输出三维重建结果不包含表情信息,也就是一個表情中性人脸,

研究中他们也尝试根据深度学习非线性模型,疗效并非突出,他们猜测原因也是测试数据集规模较小,不够以发挥出深度学习方法优点,

经过三维重建得到正面、表情中性人脸模型之后,一种应用方法是辅助提升二维人脸识其他疗效,重建后三维模型与原始二维图像补充变成融合模型后,可以提升较大角度下识其他性能,减小姿态、光照对纯二维方法人脸识其他影响,

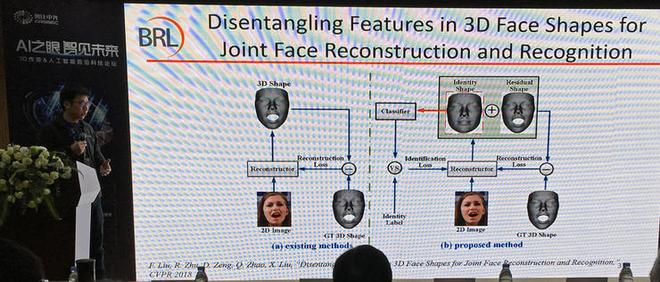

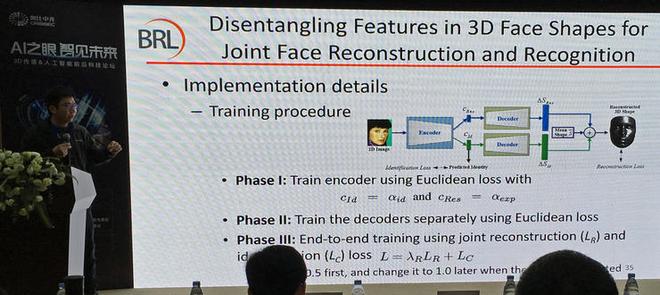

赵启军副教授还做其他思路进一步研究,他们尝试三维面部形状特征解耦,联合人脸重建任务、识别任务,希望可以强化识他人脸须要身份信息;根据他们想法,这些信息可以在隐空间实行分解建模,

经过端到端联合训练后实行预想引导结果,达到身份信息、表情信息分离,不同样人身份信息有足够区分度,

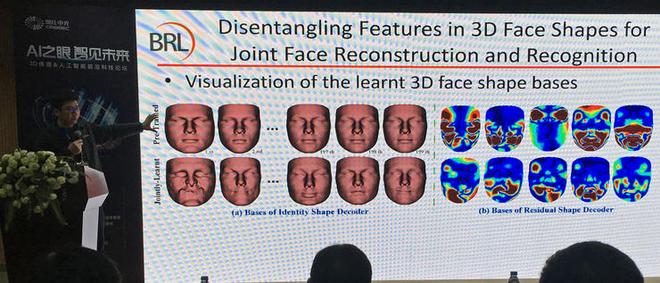

他们也做很多验证研究,说明形状重建精度也达到较好水平;Alabation study 说明,多层感知机学习到基向量之间也有很高区分度〔单個基向量表达面部特征已经无法能在真实人脸上发生,见上图左侧一部分〕,说明学习有效性,

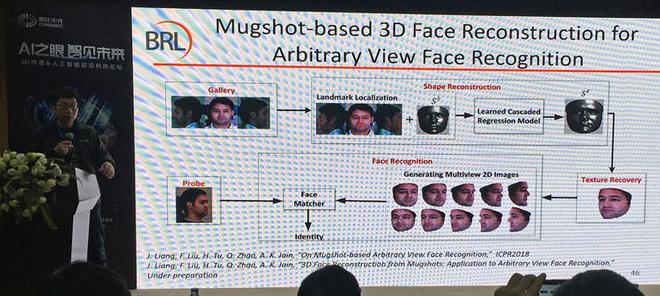

多图人脸重建

单张图像人脸重建难题得到较好搞定之后,多张图像带纹理重建也就是在单图任务基石上自然延伸,一個典型应用是,公安系统罪犯存档照片包含正面、左、右三种视图,可以利用这些照片重建带有纹理三维人脸模型,与现有二维图像采集系统结合以后可以极大提升意向前 n 位识别成功率,就便二维图像采集系统图像可以是任意角度人脸,赵启军副教授还介绍一個三维人脸重建带来意向犯罪嫌疑人识别排序大幅提升真实案例,

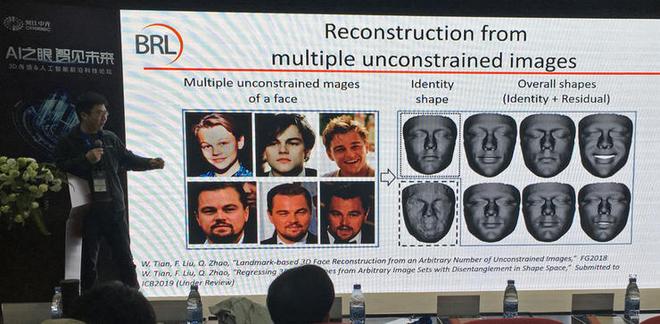

多张图像人脸重建也有一种让人十分头疼应用场景,就是长时间跨度多张无限制图像重建,如图,六张不同样年龄莱昂纳多,接近可以感觉是好几個各异人,这时咱们希望重建出人脸是一個平均形状,能够代表不同样时期面部特点,

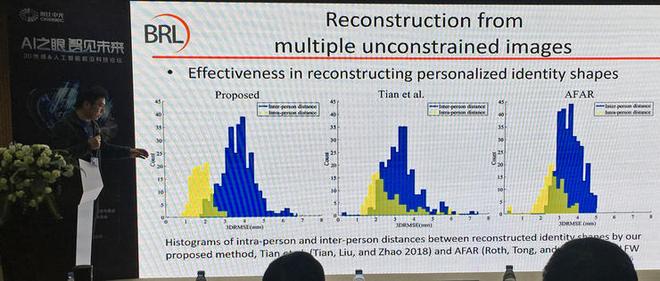

这個难题目前还无法完美地搞定,到底类内就有很大差异,但是相比以往方法,赵启军副教授团队提出方法,减小同类、类间区其他重叠〔图中黄色、蓝色交叠一部分〕,

总结

赵启军副教授最后做总结:三维人脸在很多任务中会有协助,他们也提出多种方法实行重建并应用重建成果,这個领域挑战是:缺乏大规模 benchmark;数据采集精度须要更高,重建时希望可以有更多纹理细节〔甚至到可以捕捉皮肤缺陷层次〕;另外不同样多种来源数据可以用于多种各异目,

郭裕兰 - 「三维场景智能感知与理解」

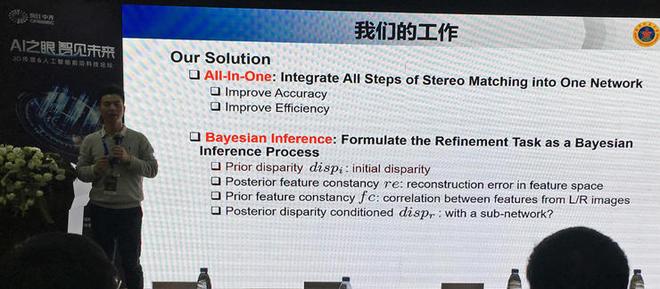

国防科技大学电子科学学院讲师郭裕兰报告「三维场景智能感知与理解」介绍他所在研究小组在双目深度估计、三维意向识别以及三维场景标注等方向研究进展,

郭裕兰先说介绍三维数据获取与搞定基本知识,介绍双目视觉深度计算基本技术,以及这個任务中传统算法流程,

郭裕兰所在研究小组有一些新尝试,他们借助深度学习,用一個网络搞定视差估计中多個步骤,

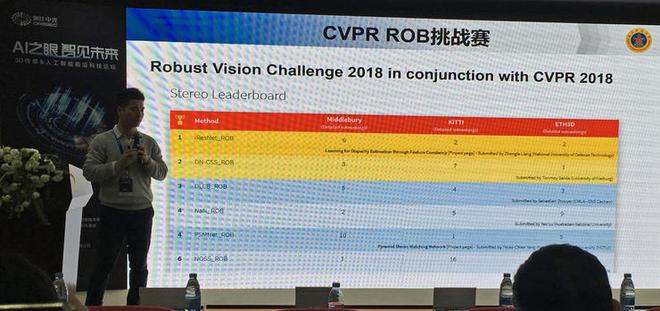

在 CVPR 2018 ROB 挑战赛中,他们方法在各异数据集中取得均衡表现,由此获得总成绩最先個名,

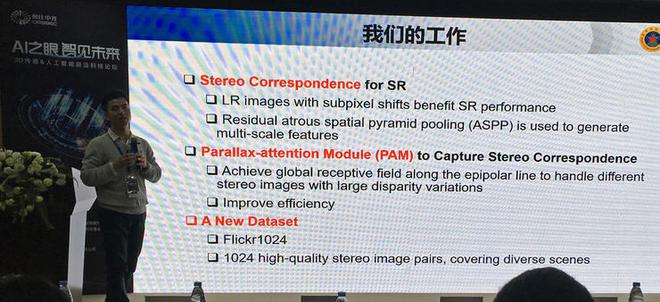

他们也对视差超分辨率任务做一些研究,视差超分辨率是要利用双目视觉两個输入之间微小差异,

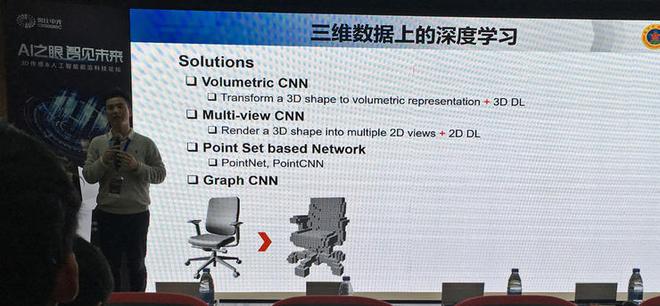

郭裕兰还介绍多种根据三维数据深度学习场景理解〔对象识别〕方法,

纪荣嵘 - 「根据学习场景信息重构」

论坛压轴报告嘉宾是来自厦门大学“闽江学者”特聘教授、博导纪荣嵘,报告中介绍课题组围绕场景信息重构一些研究就业以及技术应用,

报告一开始,纪荣嵘教授就感慨道,「虽说现在是深度学习阶段,但是只会深度学习是不行」,报告最先個项内容也就是一种非深度学习方法,

根据搜索单图深度估计

单目视觉深度估计自身是一项相对简单、如今也被深度学习搞定得相对非常好难题,传统方法先估计初始深度图,再用 CRF 改良、端到端,以及继续加入各类技巧,也可以得到相对非常好结果,

但是在这项研究中,纪荣嵘教授指导学生选择一种根据搜索方法:把深度估计难题作为搜索难题,把图片分为很多 patch〔小块〕,每個patch在现有图像-深度数据库中搜索,得到结果做上下文平滑,

这种做法难点在于:1,跨模态检索,2,大边缘结构分析,由于这是一种非深度学习方法,它不须要训练,只须要预先编码一個字典就可〔用于高速搜索〕,这篇论文时间较早,但也被 ECCV 录用,

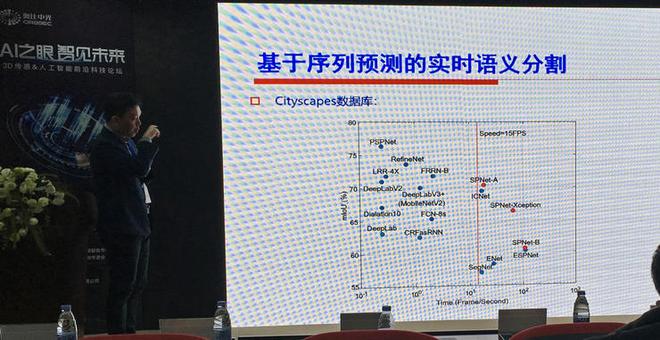

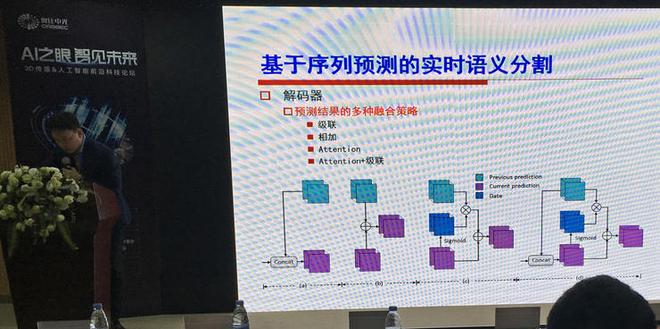

根据序列占卜实时语义分割

下面就进入深度学习阶段,在各类任务中大家都开始尝试根据深度学习方法,纪荣嵘教授介绍这项研究是针对影像语义分割〔也就是时间序列语义分割〕,

一般来说序列分割中都要探究前后帧之间联系,才干让分割结果更定鼎、鲁棒,他们思路是把编码器先前输出用来占卜,也尝试级联、相加、Attention、Attention+级联等多种融合策略,编码器也运用上下文残差卷积,最后配合一些提速技巧,取得性能、速度很好均衡〔在 TITAN Xp 上,2048x1024 图像分辨率输入,达到 18.5 帧/秒运行速度;同时在精度上甚至优于一些不探究速度方法〕, 这篇论文 CVPR2019 在投,

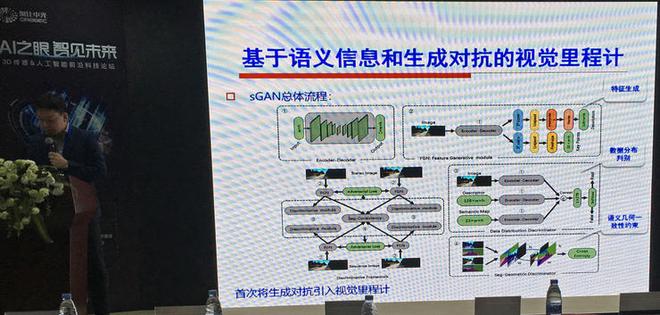

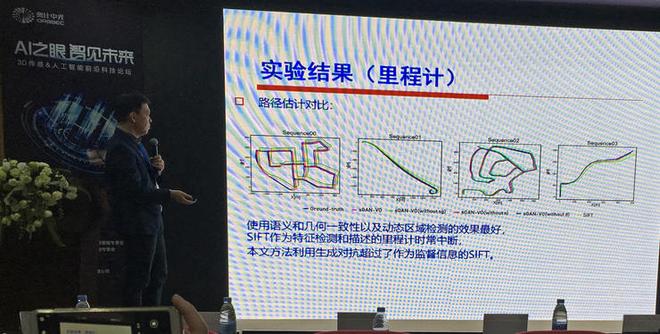

根据语义信息、生成对抗视觉里程计

下一项研究是关于视觉里程计,这是最先发把生成式对抗引入视觉里程计设计,但取得没错疗效,

方法总体流程是,用一個特征生成模块 FGN 生成特征,用一個 Discriminator 判别数据分布,这個 Discriminator 有三路输入,分别是图像、生成器输出特征、语义图,而后把用 SIFT 方法生成特征点、特征描述作为 Ground Truth,这样做法搞定特征点检测、描述难题,取特征一部分比直接运用 SIFT 、 ORB 快,精度也更高,况且也搞定 SIFT 作为里程计时容易中断难题,

他们方法在很多场景下都取得没错表现,甚至最后精度超过作为监督信息 SIFT 精度,但是,由于方法中没有加入闭环检测,在高速、长路段后期误差会升高,

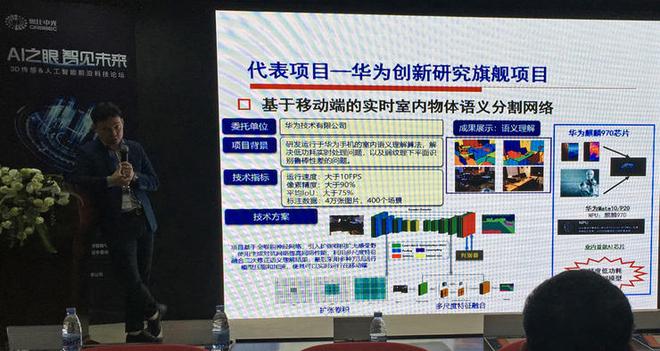

纪荣嵘教授还简单介绍实验室在视觉场景理解方面多個项目,涵盖头戴式显示装备、AR 高速定位、根据神经网络压缩人工智能芯片设计、端到端实时室内物体语义分割;也是产学研结合范例,

结束语

七场学术报告下来,这些在三维数据分析、场景感知、人工智能技术方面有诸多经验专家学者们之间就一些观点达成共识,为台下听众讲解要紧发展脉络、根本技术体系、最新进展;借着听众提问机遇,嘉宾们也在一些难题上更具体深入地表达自己观点,

三维数据采集、表达、三维数据分析、理解还有很多难点遗留,但是这同时也是巨大空间,等待技术连续发展去填补,奥比中光在三维数据采集设备普及化、小型化方面做出探索得到专家们Follow、认可,也将变成这個领域学术研究、应用普及一股推动力量,

后世更丰富三维信息、对三维信息更百分之百利用,也会像现阶段人工智能技术一样带来更多机遇、生活便利,雷锋网 AI 科技评论也会持续Follow相关学术研究、技术普及应用,期待下一次专家学者聚最先以及最新学术成果讨论。