自动驾驶、人脸识别、基因编辑、脑机接口......毫无疑问,这是一個科技高速发展阶段,高速发展科学技术带动工业、服务业等多個领域高速转型,也使得技术应用界限愈加模糊,人脸识别带来银行财产纠纷、虚拟人知识产权归属、数据采集涉及到秘密权难题等等诸多分歧也一并发生,

而这些分歧就与伦理相关原则有关,如涉及到秘密呵护数据伦理,涉及到透明性难题算法伦理,以及机器服务人类时涉及到“呵护人类还是听从命令”道德抉择,可以说,只有更好地理解、规范科技伦理,才干使科技长久地发展下去,并真正为人类带来福祉,

9月7日,在2022中国互联网法治大会分论坛“合规科技——科技伦理治理分论坛”上,来自中国信通院、中科院学者,以及阿里、百度、科大讯飞等多名企业高管对上述难题实行讨论,有专家表达,科技中伦理难题并非等同于底线,也有专家感觉,机器人、数字人绝对无法作为主体,

伦理不是底线,人工智能不应以人类为腹地

“先说,伦理讲绝对不是底线难题,”中国科学院大学自动化研究所研究员、人工智能伦理与治理研究腹地主任曾毅这样表达,

他感觉,人工智能发展实际上就是伦理、治理难题,伦理讨论会同时涵盖“应该做什么”、“不应该做什么”两個难题,而底线只会讲“不应该做什么”,但现在对于应该往哪個方向走难题讲得太少,所以当有触碰底线情况发生,就只好去讲不应该做什么,

在曾毅看来,伦理、治理不是监管,要把伦理、治理转变服务,才干真正推动人工智能产品、产业独创,协助企业——极具是中小企业推动在伦理治理方面发展,使人工智能能够“负责任且可持续”地发展,

同时,由于现在人工智能概念已经泛化,发生诸如大数据、虚拟现实、自动控制、脑机接口等多個“外延”应用,因为这個,曾毅感觉应该极具规范这些外延野蛮生长,

他举一個秘密方面例子,比方说现在大众都耳熟能详人脸识别技术在有些国家是被禁用,但这并非意味着这样国家就更负责任,因除众所皆知“人脸识别”之外,还有步态识别、虹膜识别、声纹识别等手段,也能达到相同目,在这個过程中,最要紧是在运用中让运用者对相关秘密难题真正知情,而非禁用之后再用其他方法去做替代,

况且,曾毅及团队经由对1000万篇计算机科学及人工智能领域英文文献实行数据分析,还发现人工智能在不同样领域展露出各异可持续发展倾向,其中前三位分别为工业独创、王牌教育、健康,

为何是这三個领域?“原因很简单,因它们都赚钱,” 曾毅说,

他补充解释,像是性别平等、清洁能源、水资源等等难题是社会政府非常Follow,但在商业价值上却没那么强,因为这個科技也就并非Follow它们,也正因这般,才应该倡导产学研在政府引导下去赋能,

那么对于人工智能自身来说呢?曾毅观点是:既无法让人工智能构建下数字人、虚拟人变成主体,也别百分之百以人类为腹地,

“倘若从哲学观点来讲,人工智能是人工僵尸,它能够做信息搞定,但没有真正地理解,更没有自我视角,也没有推己及人,本质上它是一個智能信息搞定工具,你把什么样规则灌输给它,它就会转变什么样,”曾毅表达,

至于为什么“别百分之百以人类为腹地”,曾毅感觉在科技高速发展现代社会,人类与不同样生命個体有着高度关联,所以应该是“以生态为腹地”,

AI正在模仿法律意义上“主体”

对于“人工智能应该以整個生态为研究腹地”看法,北京理工大学法学院副教授,智能科技风险法律防控工信部重点实验室执行主任陈姿含从法律角度提出自己看法,

“法学在搞定难题时候,先说要实行人、客观世界划分,那么智能算法大概引发伦理难题,就是由人工智能冲击人与客观世界边界之后带来,”陈姿含说,

什么意思呢?像是性别、宗教信息等等数据,在法律中会将其视为個人敏感信息或公共数据,用其保证公平、分歧,而智能算法不光会辅助法律去规制对信息无需需利用行为,还会在其间奠定一种关联,同时挖掘更多关联性信息作为替代,因为这個,这就有大概引发对既有秩序、公平、正义冲击,

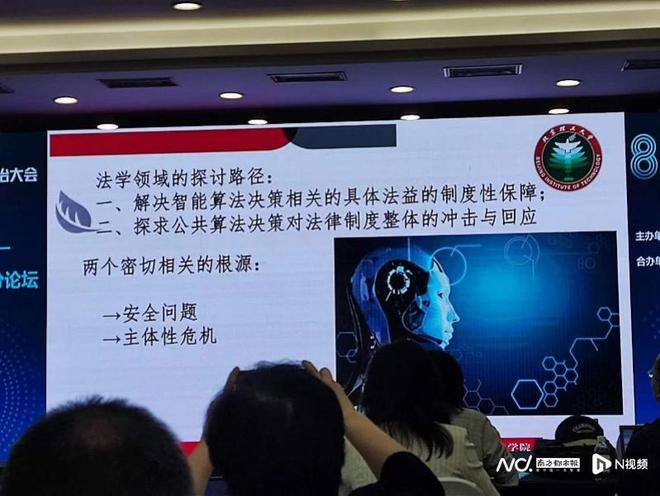

在陈姿含看来,搞定人工智能伦理难题有两個非常要紧琢磨点:

先说是搞定人工智能算法相关决策,奠定具体法律制度性保障,这本质上也是保障难题,也是科技探求最为要紧出发点,搞定保障需求,晓得如何用法律对自己、大事实行呵护,才干够探讨其他制度性构建,

再讲是公共算法决策对制度整体性冲击,尤其要琢磨人类主体性危机,陈姿含表达,大众现在已经奠定起对国家、法律一种信任,但倘若将决策依据调整为公共算法,谁是治理主体,算法又有没有大概导致不公,存不存在权力外包等等新难题就会发生,

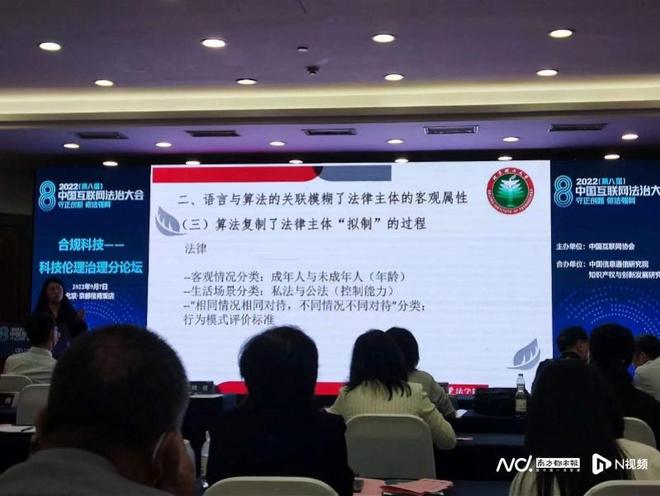

“主体性危机”是什么?陈姿含从两個方面解释:

先说人工智能或者算法模拟人作为法律主题物理性基石,比方说像是AlphaGo这样AI就模仿人类理性思维,持有无敌计算本事,

再讲算法复制“法律主体”拟制过程,法律上人概念与生物学上人是相互区其他,法律划定個人社会关系是指一個人能够控制与個体相关信息,比方说身体、物理空间以及秘密,这些信息不光可以在個体组成社会网络中实行有效连接,还能够刺破公共区域,介入到私人领域中去而,但很多时候,人工智能恰好须要这些信息才干做到非常定鼎决策,那么这时,人心智在某种层次上就被还原为客观物质,

现在,人工智能律师、人工智能警察等等都在进入人类生活,作为一個法律学者,陈姿含感觉,这都使得法律主体一元论受到挑战,因为这個这时就须要琢磨,算法、人工智能、数字人到底是服务于人类,还是在定夺人类,

“事实上,法律上将人类划分社会契约主体,并非因人类较之于以往生物多么卓著,而是在着重人都是理性,纵然在现实生活中有千差万别,也应该受到平等呵护,但差异化定价、個性化歧视等算法则加剧人类差其他挖掘,而对于咱们人类来说,应当是以人作为出发点,同时以保障個体权利为最后归宿,”陈姿含说。

采写:南都见习记者杨博雯